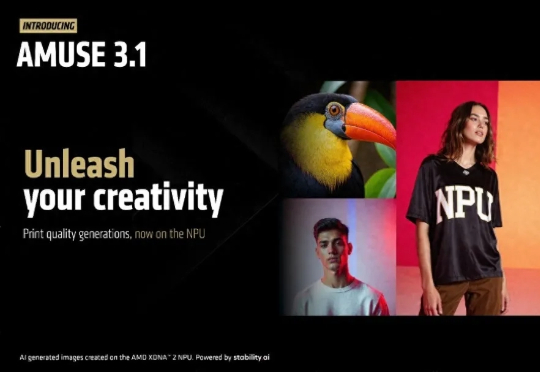

AMD携手Stability AI推出世界首款适用于Stable Diffusion 3.0 Medium的B16 NPU模型,带来更快速且画质无损的文生图功能

AMD携手Stability AI推出世界首款适用于Stable Diffusion 3.0 Medium的B16 NPU模型,带来更快速且画质无损的文生图功能AMD携手Stability AI宣布推出世界首款适用于Stable Diffusion 3.0 Medium的B16 NPU模型。该模型可直接运行于AMD XDNA 2 NPU之上,能够显著提升图像生成质量。新模型作为Amuse 3.1平台的组件之一亮相,于今天一起发布。